随着大模型能力成熟与多模态交互技术突破,AI眼镜不再仅是AR/VR的轻量化分支,而被重新定义为“下一代人机交互核心载体”,用户对实时翻译、第一视角记录、AR导航、无障碍辅助等刚需场景的期待持续升温——能否在户外大风环境下录制vlog?能否在嘈杂的环境中打电话?能否在地铁轰鸣中听清指令?艾为正深挖用户痛点,深度赋能行业头部AI眼镜产品。

一、艾为帝江™算法应用方案

艾为帝江™是艾为电子推出的上行音频算法系列,针对录音录像,通话等场景,打造多套解决方案,涵盖风噪算法、环绕声、降噪,回声消除,波束成形等核心算法,支持集成至各类主流平台,可根据不同场景需求灵活搭配算法模块,全方位赋能AI眼镜,适配户外出行、会议办公、日常记录等多元使用场景。

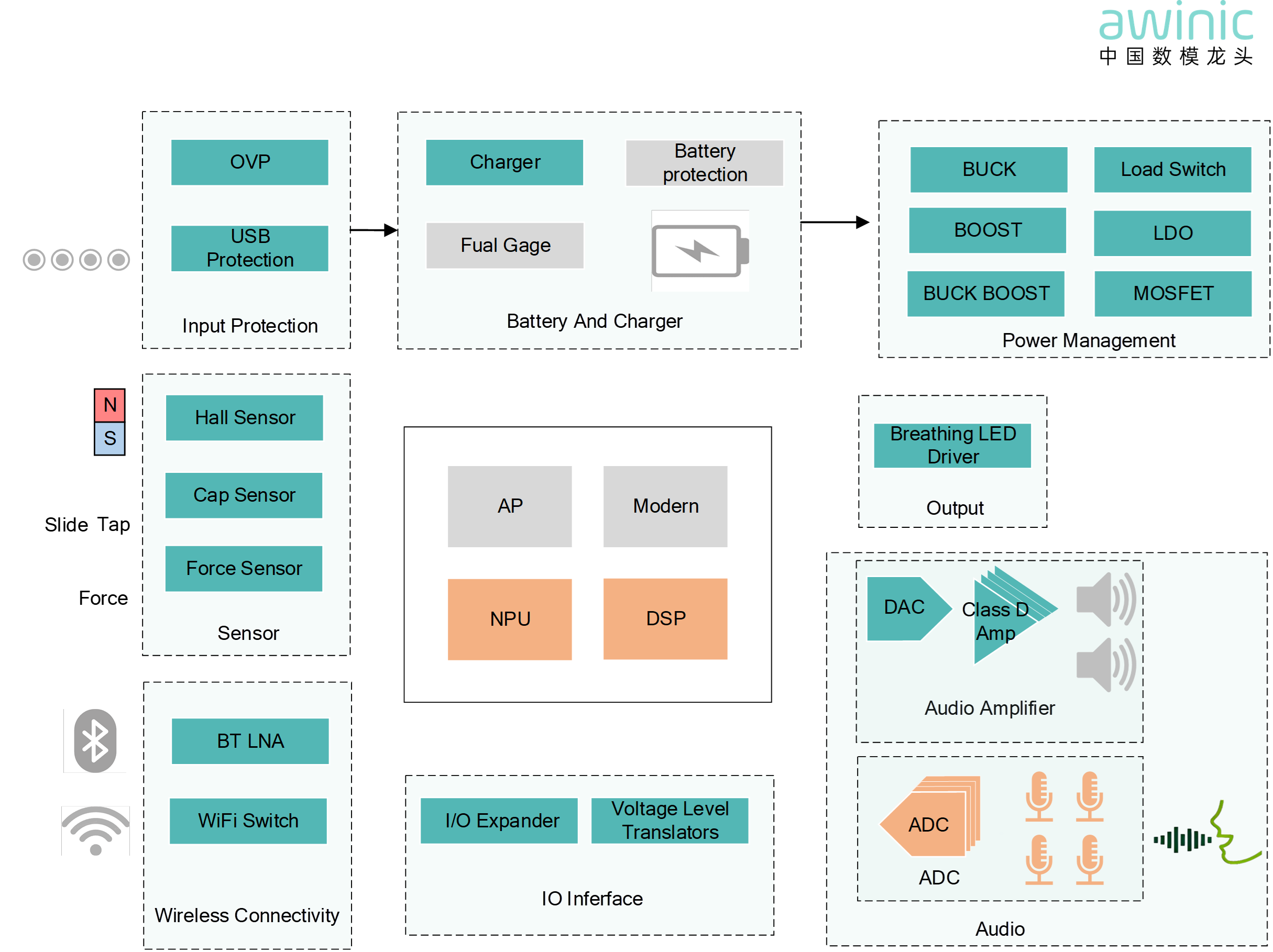

图1 AI眼镜应用框图

👓在AI眼镜典型架构中,多麦克风阵列采集的声信号,经高精度ADC完成采样后,通过低延迟总线实时送入处理单元——艾为帝江™可灵活部署于DSP或NPU,支持2-8路多麦克风阵列。

1、🌬️视频博客(Vlog)场景赋能,无惧运动风噪,人声始终清晰通透

你是否也曾留下这样的遗憾?

🚴🏻♀️ 骑行途中,风声呼啸盖过内心独白;

🏃🏻♀️ 跑步跟拍时,喘息与人声混沌难辨;

🚶🏻♀️ 户外漫步中,环境氛围饱满,却唯独缺了那一句“我想告诉你”的清澈?

图2 运动风噪场景演示

🌀为此艾为帝江™针对AI眼镜全新自研风噪算法:

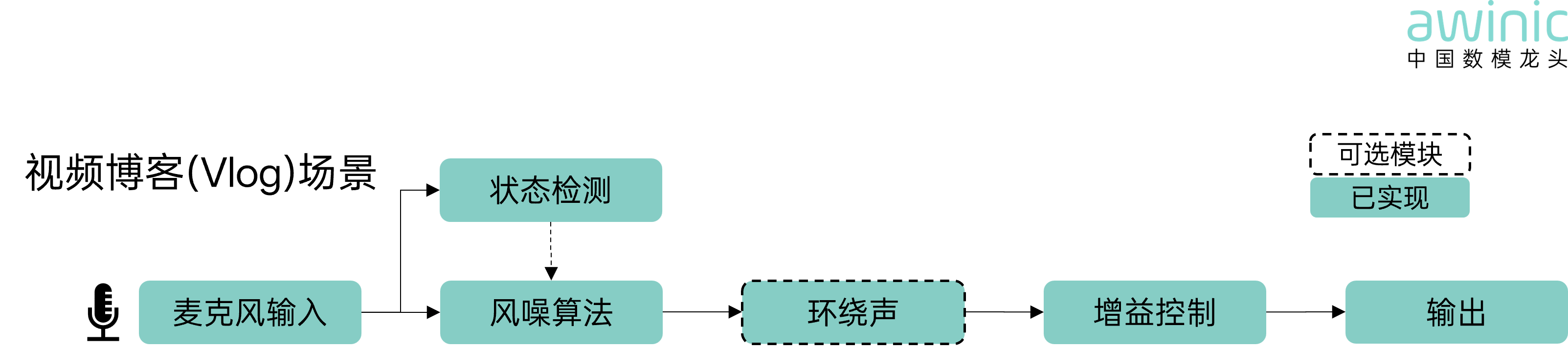

麦克风阵列采集的声信号经过风噪算法,精准识别风噪,提升语音清晰度,而后通过环绕声模块,提升氛围感,重新定义Vlog的声音美学。

有它在,风大也不怕 ——每一帧画面,都配得上清晰有温度的声音。

状态检测:传递噪声flag

可选模块(被虚线圈中的模块):非必需,适配轻量化需求

已实现(艾为蓝底):已实现模块

图3 视频博客(Vlog)场景算法框图

效果展示

风噪算法不同环境下别具一格

✅ 无风&小风|智能构建沉浸式环绕声场,让日常对话也自带电影级空间感;

✅ 大风|保留环境音,提升语音信号SNR

不是“消音”,而是让人声浮出喧嚣,让氛围沉淀为质感。

2、🌐全场景通话赋能,智能降噪,人声精准传递

你有没有这样的时刻?

💻视频会议中,自己说话像隔着一层毛玻璃,同事皱眉问:“你刚才说什么?”

🕶街边接重要电话,背景是车流轰鸣、喇叭长鸣,对方只听见一片“嗡——”;

📝在国外交流,环境很嘈杂,店员拿起一把菠菜热情介绍:“Do you like spinach?(你喜欢菠菜吗)“,翻译工具识别成“你长得像西班牙人(You look like a Spaniard)”……

图4 翻译场景演示

📞为此,艾为帝江™深入通话全链路声学现场:

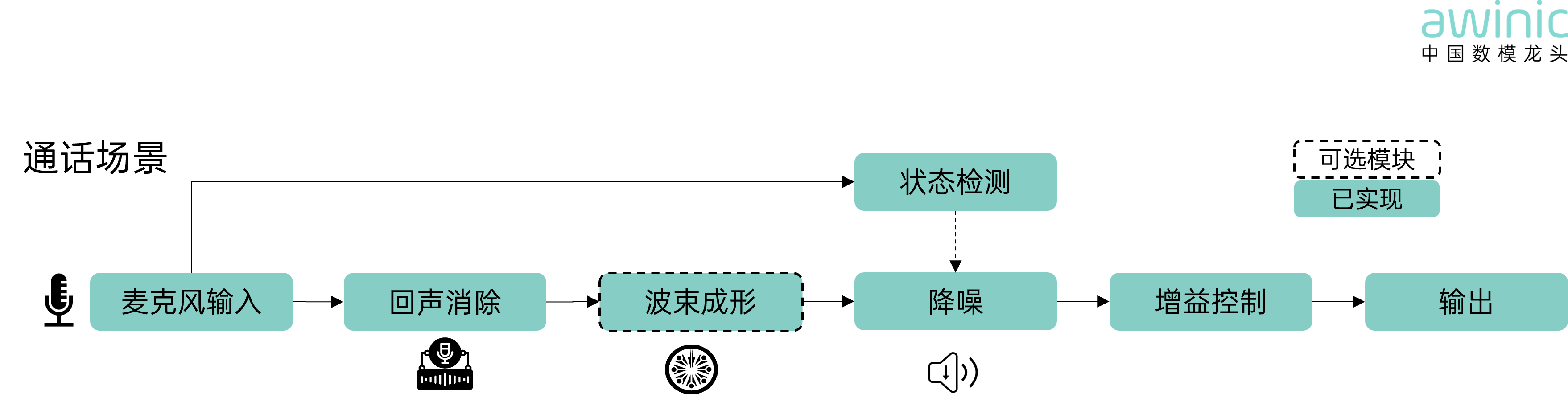

麦克风阵列采集的声信号经过回声消除模块精准剥离回声信号,而波束成形像为声音装上隐形聚光灯,动态锁定声源方向,收束有效拾音区域,最后降噪将外界噪声屏蔽,超低语音损伤带来极致通话体验。

状态检测:传递噪声flag

可选模块(被虚线圈中的模块):非必需,适配轻量化需求

已实现(艾为蓝底):已实现模块

图5 通话场景算法框图

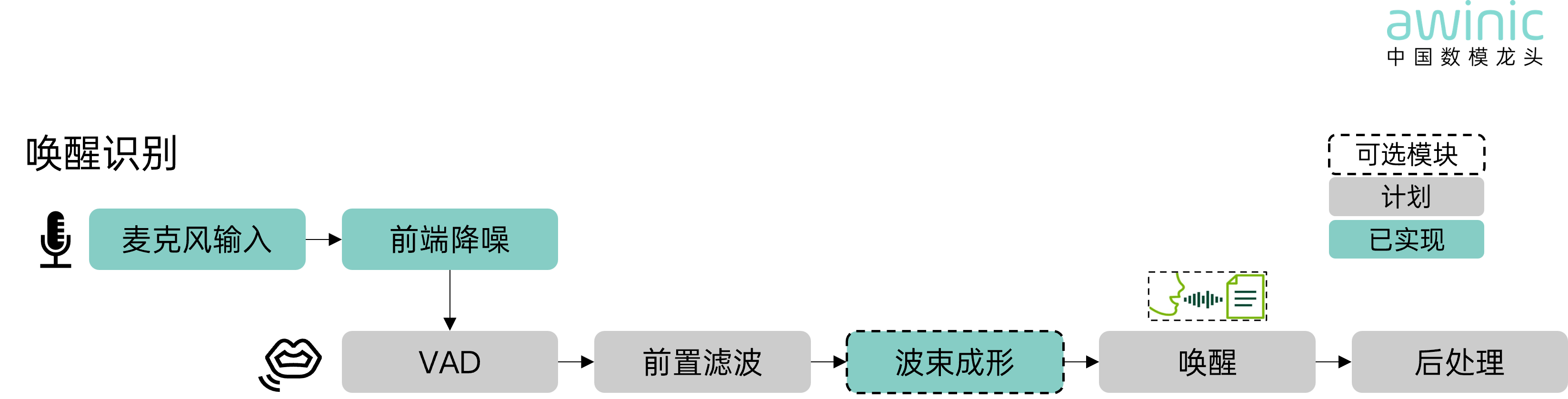

3、🗣唤醒识别的“第一道神经中枢”

你是否也曾经历过这些瞬间?

🚇在地铁里戴着眼镜想问一句天气,风声盖过了你的声音;

☕在咖啡馆和朋友聊天,刚说“嘿——”,AI眼镜却误判成唤醒;

🕺🏻走路时随口一唤,系统却沉默两秒才反应……

图6 语音唤醒场景演示

🎤于是,艾为帝江™来了。专为AI眼镜而设计的前端语音守门人:

可以在复杂环境(风噪/人声/混响)中提升语音信噪比,真实佩戴场景下,识别稳定性显著提升,字错率下降6%+。

可选模块(被虚线圈中的模块):非必需,适配轻量化需求

计划(灰底):未来规划

已实现(艾为蓝底):已实现模块

图7 唤醒识别场景算法框图

⏳唤醒这件事,早就不是“能叫醒就行”了——叫不醒着急,乱醒来尴尬,反应慢更心累。用户体验才是唯一的裁判。未来艾为将打造超低功耗,超高唤醒率的语音唤醒算法,它会更安静、更敏锐。毕竟,最好的交互,是你根本没意识到它在工作。